文/LISA 圖/Shuttterstock、蔡英文 Tsai Ing-wen粉絲專頁、文化部提供

人們容易相信自己親眼所見的事物,在修圖技術、拍照軟體普及之前,照片、影片所呈現出的內容足以呈現事實,可信度相當高。然而,在今日靠著一個手機APP改變一個人的臉蛋、身材比例,又或是將原本陰天的風景照改成萬里無雲,已經不足為奇。利用AI技術讓電腦深度學習,並且用另一個完全不同的內容覆蓋事實,以此來騙過人們的眼睛,「Deepfake」便是現今科技發展出的新技術,同時也是現代人的新挑戰。

什麼是Deepfake?這個技術如何運作?

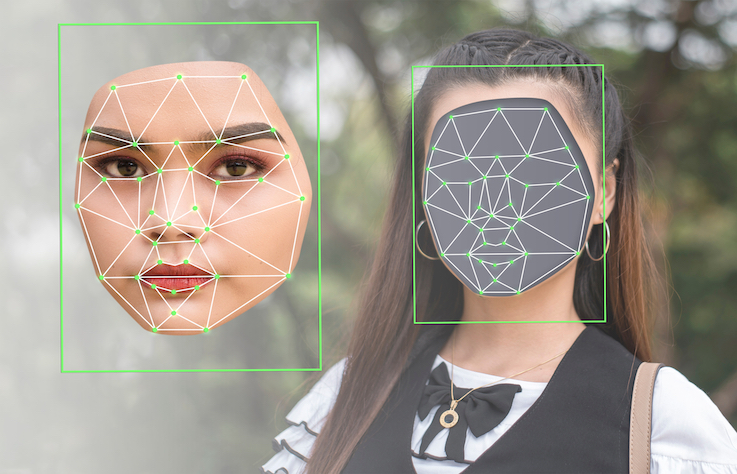

Deepfake是由英文「deep learning」(深度學習)和「fake」(偽造)混合而成的詞,利用人工智慧進行的圖像合成技術,可以把既有的圖像或影片疊加到另外一個圖片或影像上。中文有人稱之為「深偽技術」,因為這樣的深度偽造很可能在人們沒有多加留意或無法判斷的情況下,把人工合成的影像視為事實。一般來說,一般的修圖技術仍可能讓視聽者透過些微的不自然感,察覺到影片可能經過人為修飾,而非事實。然而Deepfake是利用AI人工智慧,讓電腦重複學習,以達到更自然的修圖。

只要你能夠蒐集到要合成的對象的照片,並且利用軟體程式進行,電腦將會自己學習如何自然的修圖。或許你會想:「但這個技術聽起來滿高深的,一般人應該無法非常迅速的上手吧?」事實上,目前Deepfake的AI系統已經可以由一般人任意取得,且相當容易操作,日前在台灣也發生利用Deepfake技術,在網路上散布許多知名網紅與色情影片合成的犯罪事件,也是因為此一技術相當容易取得而出現的負面結果。

當照片變為「照騙」,你還信任自己的眼睛嗎?

這樣的事件並不是只在台灣發生,也並非剛開始出現的負面影響,事實上,美國早已出現將政治人物作為Deepfake的對象,美國總統歐巴馬和眾議院議長裴洛西(Nancy Pelosi)也都曾成為造假影片的當事人,而且在網路上瘋傳達到百萬以上的觀看次數。外媒Buzzfeed在2018年製作了一段歐巴馬的合成影片,為了警示人們假新聞的威脅;2019年,中國也曾推出手機APP「ZAO」的換臉軟體,主打可將自己的臉換成電影中的角色,與朋友共演電影橋段。

不少人對於這樣的新技術感到新奇,但同時也點出當今社會在資訊快速傳遞下面臨的問題:「假資訊」、「假新聞」,政治上可能被用於操弄意見、抹黑政敵的工作,我們對於媒體的信任度可能開始下降,而且若被拿來做非法的用途,個人隱私和基本人權都將面臨挑戰。人們如果無法以五感確認事實,將會花費越來越多成本在確認和找尋真相。

科技的善惡 取決於人類的使用方式

就現今所看到的事件,會讓人覺得Deepfake就是個邪惡的新科技,但事實上,這個技術也能讓百年前的人物重新在你的眼前「活過來」。國立臺灣文學館為了紀念和慶祝臺灣文化協會創立百年,所舉辦的「百年情書.文協百年特展」中,就以Deepfake將六位深具代表性的文協成員:賴和、盧丙丁、李獻璋、陳澄波、林氏好、楊逵重現於現代。原本僅在照片中出現的人物,像是從中走出來「像人一般」真實,也拉近了人們與過去歷史人物的距離。

這項技術越來越成熟,有一天也將可能普及於我們的日常生活中,而這將會帶來正面還是負面的影響,我們尚不得而知,但科技本身並沒有善與惡,而是端看使用者如何利用。